概述

平台介绍

助睿 ETL 数据集成平台,是 Uniplore(助睿)一站式数据智能平台旗下的核心数据集成子产品,具备低门槛易用性、高性能处理能力与灵活的扩展适配能力,为企业级数据集成场景提供全链路解决方案。

平台以可视化拖拽式开发模式,大幅降低数据开发门槛,提升研发人员工作效率。核心采用 「一次设计、多地运行」 的架构理念,用户可通过 Web 可视化界面完成作业与转换的开发设计,不仅能在本地 / 远程引擎上直接运行,还可通过 Apache Beam 无缝适配 Spark、Flink、Google Dataflow、AWS EMR 等多种大数据执行引擎。同时,平台内置全生命周期管理能力,可支撑项目在开发、测试、生产多环境间的平滑切换与迁移,无需大量适配改造工作,实现数据集成项目的高效交付与运维。

平台特性

全链路元数据驱动

助睿 ETL 采用全元数据驱动的架构设计,平台内所有对象类型均通过元数据标准化定义,覆盖数据读取、处理、写入的全流程,以及作业与转换的调度协调逻辑。元数据作为平台的核心驱动底座,基于开源内核的高可用引擎架构,通过标准化插件体�系,可灵活扩展引擎能力,适配企业多样化的数据处理与集成需求。

一次设计、多地运行

作业与转换作为平台数据处理逻辑的核心载体,标准化定义了数据处理的全流程规则。基于统一的标准化设计,用户完成一次业务逻辑开发后,仅需调整少量环境配置,即可实现跨环境、跨引擎的无缝运行。平台原生支持本地、远程服务引擎的直接运行,同时通过 Apache Beam 框架,可将开发完成的逻辑一键部署至 Apache Spark、Apache Flink、Google Dataflow、AWS EMR 等主流大数据执行引擎,最大化复用开发成果,降低多环境适配成本。

可视化低代码开发

平台提供 Web 端全可视化拖拽式开发界面,用户无需编写复杂代码,即可快速完成转换与作业的流程设计。可视化开发模式让数据开发人员、数据工程师摆脱底层代码实现的束缚,将核心精力聚焦于业务逻辑的落地与优化,真正实现以业务为核心的低门槛数据集成开发,大幅缩短项目交付周期。

内置生命周期管理能力

针对数据集成项目开发、测试、部署、运维的全流程管理痛点,平台内置了完整的项目生命周期管理能力。研发与运维人员可通过平台实现多项目、多环境、多运行引擎的统一配置管理与一键切换,��同时原生支持 Git 版本控制体系,可实现开发流程的版本追溯、协同开发与合规管控,全方位保障数据集成项目的稳定交付与高效运维。

核心概念

作业(Workflow)和转换(Pipeline)

作业(Workflow)和转换(Pipeline)是数据集成平台最核心的两个基础概念,二者共同构成了数据集成流程的核心载体:作业面向任务流程管控,定义了完整业务流程的执行逻辑与生命周期;转换面向数据处理流转,定义了单一场景下的数据处理规则与数据流走向。

转换(Pipeline)

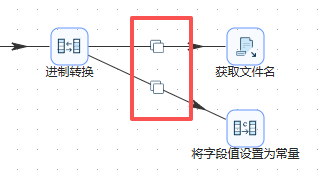

转换(Pipeline)由一系列数据处理步骤(Transform)与步骤连接线(Hops)组成,对应一段完整的数据流处理逻辑。其中,每个步骤负责完成一项特定的数据处理工作,节点连接线则用于定义数据的流动方向,连接线分为「主输出步骤」与「错误输出步骤」两类,可实现数据的分流处理。下图为数据校验场景的转换示例:

作业(Workflow)

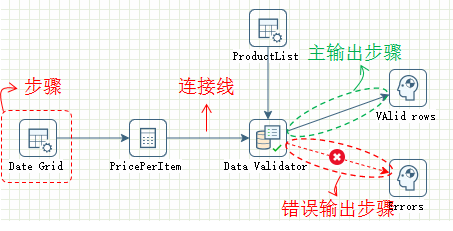

作业(Workflow)由一系列任务项(Action)与任务连接线(Hops)组成,用于定义任务项的执行顺序与依赖关系,实现完整业务流程的调度管控。每个作业必须包含「START 启动」任务项作为流程入口,任务项之间通过连接线完成流程串联。下图为作业流程示例:

步骤(Transform)和任务项(Action)

步骤(Transform)与任务项(Action)分别是转换与作业的最小执行单元,平台基于功能场景对两类单元进行了标准化分类,开箱即用。

步骤(Transform)

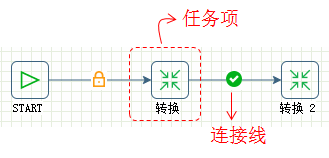

步骤(Transform)是转换内的最小数据处理单元,平台按功能场景将其划分为输入、输出、转换、脚本、查询、连接、检验、统计等多个类别,每个步骤对应一项特定的数据处理能力。例如「Excel 输出」组件,可将处理后的数据流直接输出为 Excel 文件格式。平台核心对象分类如下图所示:

任务项(Action)

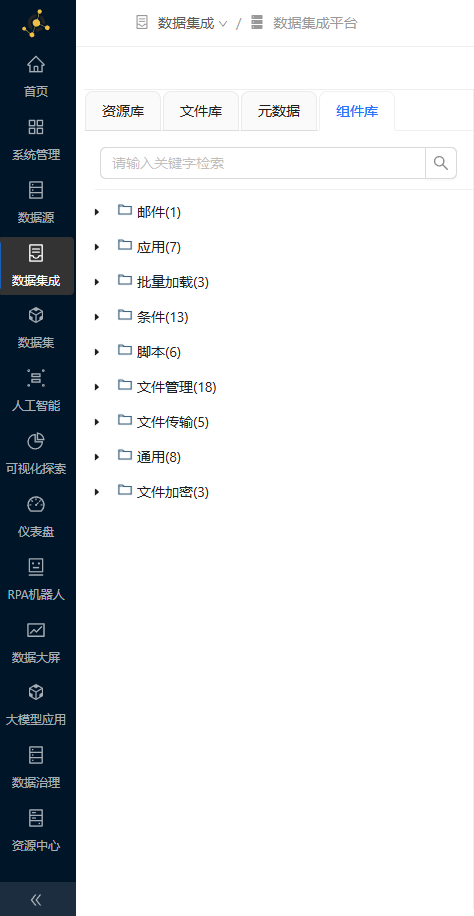

任务项(Action)是作业内的最小执行单元,平台按用途将其划分为通用、邮件、应用、文件传输等多个类别�,覆盖作业调度的各类场景。其中通用类别下的「启动」任务项,是所有作业必须包含的流程起点组件。作业任务项分类如下图所示:

节点连接(Hops)

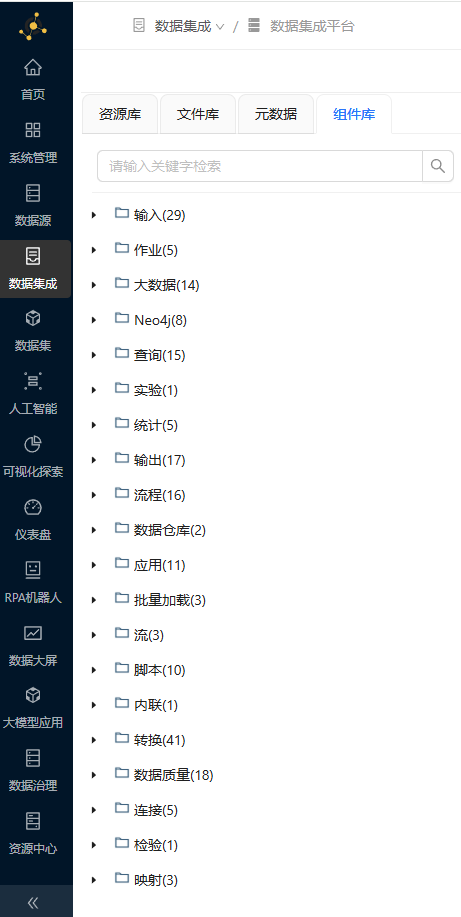

节点连接(Hops)是数据与流程流转的核心通道,用于连接两个步骤或任务项,实现数据的传递与流程的串联。针对数据传输场景,平台支持随机分发、复制发送两种核心传输模式;需要特别注意的是,在转换流程中,各数据处理步骤为独立线程运行,因此数据处理的执行顺序并非完全由节点连接的箭头方向决定。数据传输模式配置如下图所示:

下图为选择复制发送的图标标识: